Propiedad intelectual e inteligencia artificial no parecen llevarse bien... O no de momento. En un fallo significativo, la Corte del Distrito Norte de California emitió una sentencia en un caso de demanda presentado por un colectivo de artistas contra Stability AI, Midjourney, DeviantArt y Runway AI. Los artistas acusan a las empresas de utilizar sus obras protegidas por derechos de autor para entrenar modelos de inteligencia artificial (IA) sin su consentimiento, violando así sus derechos.

El caso, encabezado por artistas como Sarah Andersen, Kelly McKernan y Karla Ortiz, busca abordar las implicaciones legales del uso de obras artísticas en la formación de modelos de IA. Los demandantes alegan que las empresas utilizaron sus obras en conjuntos de datos para entrenar herramientas como Stable Diffusion, una tecnología que permite la creación de imágenes mediante IA. Según la demanda, estas obras fueron utilizadas sin autorización, lo que constituye una violación directa de los derechos de autor.

La polémica no es nueva, pero sí relevante ya que, por ejemplo, Karla Ortiz es una de las ilustradoras de grandes éxitos cinematográficos como Thor: Ragnarok, Doctor Strange o Jurassic World.

Decisión del tribunal

El juez encargado del caso decidió otorgar y denegar partes de las mociones para desestimar las reclamaciones presentadas por los artistas. El tribunal permitió que siguiera adelante la acusación de infracción directa de derechos de autor contra Stability AI, pero desestimó otras reclamaciones, incluidas aquellas relacionadas con la eliminación y alteración de la información de gestión de derechos de autor bajo la Digital Millennium Copyright Act (DMCA).

Esta decisión del juez significa que el caso sigue adelante. Como explica uno de los abogados de la defensa Matthew Butterick en El País, "ahora se nos permite pedir documentos a los acusados y tomar declaraciones o testimonios. Solicitaremos a las empresas que entrenaron los modelos de generación de imágenes por IA que aporten información sobre cómo copiaron el trabajo de los demandantes y de qué forma la han usado en el desarrollo de sus herramientas".

Una de las cuestiones clave fue la alegación de los demandantes de que Stability AI, junto con Runway AI, utilizó un conjunto masivo de imágenes de internet para entrenar sus modelos de IA. Los artistas sostienen que estas imágenes fueron extraídas de plataformas como DeviantArt sin su permiso, lo que constituye una infracción de sus derechos de propiedad intelectual.

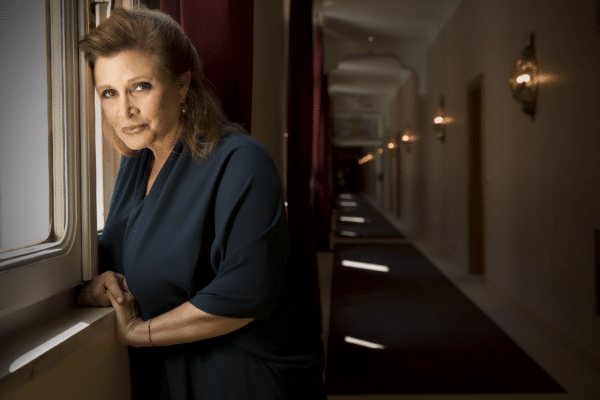

Ortiz, celebró la noticia de esta resolución judicial y en redes sociales aseguró que "somos potencialmente uno de los mayores casos de la historia de infracción de derechos de autor. ¡Estamos emocionados por la siguiente etapa de nuestra lucha!”. Y es que este fallo parcial destaca los desafíos en la intersección de la propiedad intelectual y la inteligencia artificial.

El tribunal también otorgó a los demandantes la posibilidad de enmendar ciertas reclamaciones que fueron desestimadas, lo que sugiere que la batalla legal está lejos de terminar. Los próximos pasos podrían incluir nuevas rondas de alegatos o, potencialmente, un acuerdo entre las partes.

Más demandas

Pero allá por 2022, hubo quien ya vio que entrenar modelos de IA podría traer problemas. En el caso de Butterick, Copilot de Microsoft le puso en alerta y presentó en noviembre de ese año una demanda que todavía no se ha resuelto, acusando a la compañía de Bill Gates de violar los acuerdos de licencia abierta.

En enero de 2023 llegó esta la de los ilustradores. En julio fue el turno de un grupo de escritores, que demandaron a OpenAI y Meta por incluir en sus bases de datos de entrenamiento libros escritos por ellos. En octubre del año pasado, varios sellos discográficos, incluyendo Universal Music Group, demandaron a Anthropic por entrenar sus algoritmos con materiales protegidos por derechos de autor.

Desde entonces: Getty Images demandó a Stability AI por usar sin permiso imágenes de sus archivos, The New York Times llevó a los tribunales a OpenAI y Microsoft por usar millones de artículos en el entrenamiento de ChatGPT y más escritores se querellaron por los mismos motivos contra Anthropic.

No parece que esto vaya a terminar y con la llegada de herramientas como Sora, los derechos audiovisuales también pueden estar en peligro. Es por ello que, cada vez más, se hace necesaria una regulación que evite problemas y demandas por derechos de autor tanto a las empresas como a los autores.