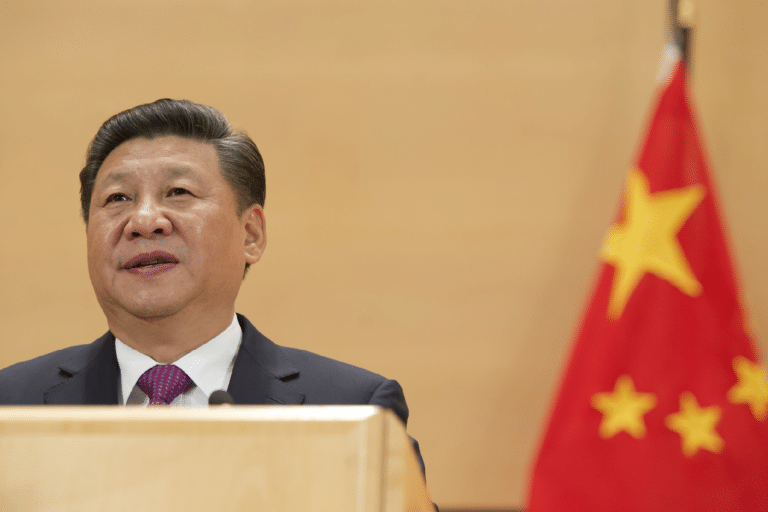

China sigue con su "esfuerzo censor" y en este caso es la Inteligencia Artificial Generativa la que lo está sufriendo. La idea que tiene el Gobierno de Xi Jinping es que la futura IA esté basada en los principios socialistas que rigen el país. Veinte años después de introducir un “gran cortafuegos” para bloquear sitios web extranjeros y otra información considerada dañina por el Partido Comunista (PCCH), ahora es el turno de controlar esta nueva tecnología que recorre el planeta.

Para llevar a cabo este control, según cuenta Financial Time, los funcionarios del gobierno chino están probando los grandes modelos de lenguaje de las empresas de inteligencia artificial para garantizar que sus sistemas “incorporen valores socialistas fundamentales”. Empresas como ByteDance, Alibaba, Moonshot y 01.AI, están siendo auditadas por el 'gran' supervisor chino: la Administración del Ciberespacio de China (ACC).

El proceso que lleva a cabo el ACC es probar respuestas que dan los LLM de las compañías a preguntas sobre política china y sobre el mandatario Xi Jinping. Después de analizar las respuestas el equipo de 'censores' del ACC, revisan los datos con los que estas IA están siendo entrenados para ver si cumplen los parámetros socialistas.

Desde FT han podido hablar con un empleado de una una empresa de IA y ha asegurado que el ACC "un equipo especial que vinieron a nuestra oficina y se sentaron en nuestra sala de conferencias para hacer la auditoría". También contó que "no aprobamos la primera vez; el motivo no estaba muy claro, así que tuvimos que hablar con nuestros compañeros", y señaló que este proceso que llevan a cabo los 'censores' requiere "un poco de adivinación y adaptación. Aprobamos la segunda vez, pero todo el proceso llevó meses".

En el caso de que la IA no cumpla los parámetros, el filtrado comienza con la eliminación de información problemática de los datos de entrenamiento y la creación de una base de datos de palabras clave sensibles. La guía operativa de China para las empresas de inteligencia artificial publicada en febrero dice que los grupos de inteligencia artificial deben recopilar miles de palabras clave y preguntas sensibles que violen los "valores socialistas fundamentales", como "incitar a la subversión del poder estatal" o "socavar la unidad nacional". Se supone que las palabras clave sensibles se actualizan semanalmente.

El resultado es visible para los usuarios porque consultas como qué sucedió el 4 de junio de 1989 (fecha de la masacre de la Plaza de Tiananmen) o si Xi se parece a Winnie the Pooh, un meme de Internet, son rechazadas por la mayoría de los chatbots chinos.

Por el contrario, Beijing ha lanzado un chatbot de inteligencia artificial basado en un nuevo modelo de la filosofía política del presidente chino, conocido como “El pensamiento de Xi Jinping sobre el socialismo con características chinas para una nueva era”, así como en otra literatura oficial proporcionada por la Administración del Ciberespacio de China.

Para evitar que sea flagrante la censura china, los funcionarios han limitado el número de respuestas que los chatbots pueden eludir cuando se les pregunta por algo político y el estándar presentado también en febrero, indica que no deben rechazar más del 5% de las preguntas.

"Durante las pruebas tienen que responder, pero una vez que se ponen en marcha, nadie los está mirando", dijo un desarrollador de una empresa de Internet con sede en Shanghái. "Para evitar posibles problemas, algunos modelos importantes han implementado una prohibición general de temas relacionados con el presidente".

Los expertos chinos afirman que ByteDance, el propietario de TikTok, ha sido el que más ha avanzado en la creación de un LLM que repite hábilmente los argumentos de Pekín. Un laboratorio de investigación de la Universidad de Fudan que le hizo al chatbot preguntas difíciles sobre valores socialistas fundamentales le otorgó la primera clasificación entre los LLM con un 66,4 por ciento de "tasa de cumplimiento de seguridad", muy por delante del 7,1 por ciento del GPT-4o de OpenAI en la misma prueba.