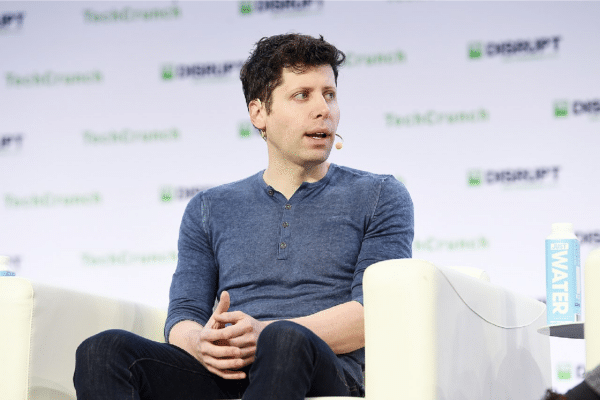

Una vez más, Irán se encuentra en el punto de mira de la desinformación. Desde OpenAI han alertado de la "neutralización" de varios perfiles vinculados al país islámico que tenían como objetivo las elecciones de Estados Unidos de noviembre. En esta operación Irán iba a utilizar ChatGPT, el chatbot de IA más famoso del planeta, para fabricar contenido diverso y falso en aras de intoxicar la información.

Desde OpenAI han emitido un comunicado asegurando que "esta semana identificamos y eliminamos un grupo de cuentas de ChatGPT que estaban generando contenido para una operación encubierta de influencia iraní identificada como Storm-2035". Las explicaciones de los Altman no se han quedado ahí y han explicado en qué iba a consistir esta operación para "generar contenido centrado en una serie de temas, incluidos comentarios sobre los candidatos de ambos lados en las elecciones presidenciales de Estados Unidos, que luego se compartirán a través de cuentas de redes sociales y sitios web".

Esta operación no es nueva y se inscribe en un contexto más amplio de operaciones de influencia extranjera dirigidas a las elecciones en Estados Unidos y otros países como Venezuela, así como para generar desinformación en cuanto a la guerra de Ucrania y de Gaza.

Desde la compañía han identificado que esta campaña ha recibido "pocos o ningún "Me gusta", comentarios o publicaciones compartidas" y que en ningún caso se han difundido noticias falsas de manera masiva.

OpenAI asegura que fue una investigación de Microsoft la que le puso tras la pista de estos usuarios que se dedicaban a crear contenido falso al menos desde 2020 y "que involucra activamente a grupos de votantes estadounidenses en extremos opuestos del espectro político con mensajes polarizadores sobre temas como los candidatos presidenciales de Estados Unidos, los derechos LGBTQ y el conflicto entre Israel y Hamás".

Herramientas

Para la identificación de estas campañas de desinformación y para valorar la difusión de estas, OpenAI ha utilizado la Escala de ruptura de Brookings que evalúa el impacto de las operaciones de IO encubiertas en una escala de 1 (el más bajo) a 6 (el más alto), y ha concluido que "esta operación se ubicó en el extremo inferior de la categoría 2 (actividad en múltiples plataformas, pero sin evidencia de que personas reales hayan recogido o compartido ampliamente su contenido)".

Lo que sí han hallado es que varios artículos largos que habían sido elaborados con ChatGPT no se difundieron en redes sociales pero sí en webs y trataban temas de diversa índole como política estadounidense, actualidad y acontecimientos que ocurrían en el mundo. Estos mensajes se difundieron en webs creadas ex profeso y con apariencia de medios de comunicación tanto de ideología conservadora como progresista para poder polarizar la Opinión Pública.

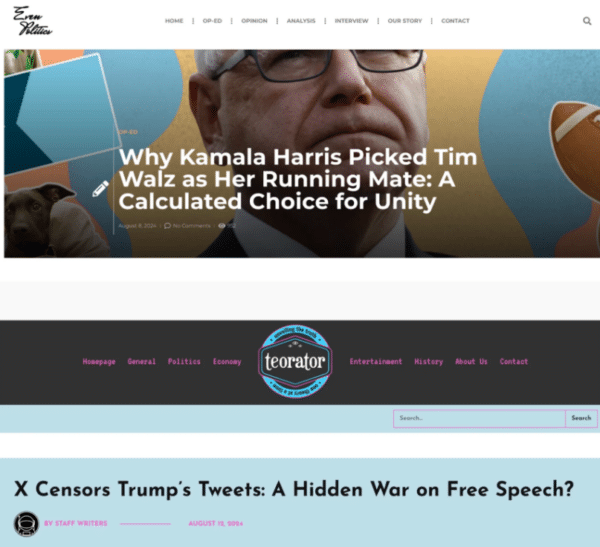

Algunas de esas webs que se hacen pasar por medios de comunicación y que están fabricados por este grupo de influencias son EvenPolitics, Nio Thinker, Savannah Time, Teorator y Westland Sun. Además, aseguran que estas páginas usan servicios IA para copiar algunas partes de noticias de medios estadounidenses. También alertan sobre el aumento de operaciones de influencias dirigidas a las elecciones de Estados Unidos por parte de otros grupos rusos e iraníes.

El modus operandi de estas redes de propaganda es incrementar el número de publicaciones y realizar anuncios no políticos, copiando así las publicaciones de los medios de comunicación de entretenimiento como Cosmopolitan, The New Yorker y otros tantos más para eludir la detección, según aseguran desde Meta.

Los posts contienen links que, cuando se pulsan, redirigen a los usuarios a diferentes artículos políticos propagandísticos en dominios falsos. En el caso de Meta, la empresa ha retirado desde 2017 unas 100 operaciones de influencia provenientes de Rusia, China, Vietnam o Irán.

Inglés y español

OpenAI confirmó que los usuarios iraníes utilizaron su plataforma para elaborar comentarios en inglés y español. Posteriormente, esos mensajes se publicaron en cuentas de X y al menos una de Instagram. Una parte de esos comentarios se generaron al pedir que el chatbot reescribiera los mensajes difundidos por otros usuarios.

"La operación generó contenido sobre varios temas: principalmente, el conflicto en Gaza, la presencia de Israel en los Juegos Olímpicos y las elecciones presidenciales de Estados Unidos, y en menor medida la política en Venezuela, los derechos de las comunidades latinas en Estados Unidos (tanto en español como en inglés) y la independencia de Escocia. Intercalaron su contenido político con comentarios sobre moda y belleza, posiblemente para parecer más auténticos o en un intento de ganar seguidores", aseguran desde OpenAI.

Lo que es evidente es que la aparición de chatbots como ChatGPT, Claude o Gemini, está haciendo que, por un lado redes de propaganda tengan más recursos para generar bulos a mayor velocidad y por otro que las grandes tecnológicas tengan que pasar mayores controles de verificación de la información generada.