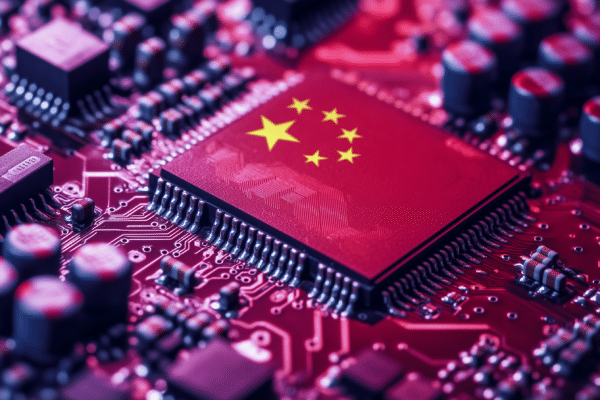

California se ha convertido en el epicentro de un acalorado debate sobre la regulación de la inteligencia artificial (IA). La ley SB 1047, que avanza en la legislatura estatal, ha generado oposición tanto de startups emergentes como de gigantes tecnológicos, quienes advierten que las restricciones propuestas son demasiado vagas y podrían frenar el desarrollo tecnológico.

La ley, considerada por muchos como fundamental para definir cómo se regulará la IA en todo Estados Unidos, exige que los desarrolladores de modelos de IA realicen pruebas de seguridad para mitigar riesgos de daños catastróficos. Este tipo de daños incluye ataques cibernéticos que provoquen pérdidas de al menos 500 millones de dólares o víctimas masivas, además de requerir que los sistemas puedan ser desactivados por un humano si se comportan de manera peligrosa.

El proyecto SB 1047 ya ha sido aprobado por el Senado de California y ha avanzado en dos comités de la Asamblea Estatal. Sin embargo, enfrenta una dura resistencia en su camino hacia la aprobación final. Según informes, representantes de Meta Platforms, OpenAI, y otras empresas líderes en el sector han expresado su preocupación, argumentando que la ley, tal como está redactada, carece de especificidad en sus requerimientos y podría sofocar la innovación en el estado.

Empresas como Google, Microsoft y Anthropic han propuesto enmiendas a la ley, señalando que elementos clave para la implementación del marco regulatorio aún no están definidos. Según una carta enviada por Microsoft, citada por el Wall Street Journal, estas indefiniciones podrían conducir a inversiones mal orientadas y resultados engañosos.

El senador Scott Wiener, autor de la ley, ha señalado que está abierto a ajustes y ha insistido en que la ley no es excesivamente restrictiva. No obstante, la industria tecnológica sigue preocupada. Algunos académicos y desarrolladores, como el profesor Andrew Ng de la Universidad de Stanford, han manifestado que ciertas disposiciones son tan ambiguas que no saben cómo cumplirlas.

A pesar de las tensiones, la SB 1047 ha recibido apoyo de algunos investigadores en IA y académicos, quienes argumentan que es necesario establecer estándares de seguridad claros. Una carta firmada por varios expertos en IA, entre ellos Geoffrey Hinton y Yoshua Bengio, sostiene que eliminar las medidas básicas de la ley sería un error histórico, especialmente ante la próxima generación de sistemas de IA aún más avanzados.

El desenlace de esta batalla legislativa en California podría tener implicaciones a nivel nacional, dada la influencia del estado en la política y la industria tecnológica de Estados Unidos. Mientras tanto, se espera que la discusión sobre cómo regular la IA continúe en el ámbito estatal y federal en los próximos meses.