Es el argumento que ha dado el catedrático británico Dan Hunter para poner en valor la inteligencia artificial en el sector de la abogacía. Porque, al final, los profesionales del derecho hacen un uso extensivo e intensivo del lenguaje. El decano ejecutivo de la The Dickson Poon School of Law, la escuela de derecho del King’s College ha hablado en el escenario del EMEA NewLaw Summit, un evento diseñado para poner sobre la mesa los retos que afronta el ámbito legal y fiscal en el plano digital.

Organizado por la división Tax & Legal de PwC, así como por la asociación DigitalES y el diario El Confidencial, el encuentro profundiza en la intersección en el apoyo que presta la tecnología a los profesionales de estos sectores. Y, desde luego, la inteligencia artificial ha sido un factor recurrente a lo largo de la primera jornada.

La introducción, a cargo de Joaquín Latorre, socio responsable de PwC Tax & Legal, y Víctor Calvo-Sotelo, director general de DigitalES, ya anticipaba los temas que trataría el EMEA NewLaw Summit. La necesidad de adaptarse a los nuevos tiempos, la mediación de la tecnología —el ámbito digital y, en última instancia, la IA— o el impacto en el trabajo de los profesionales han sido asuntos que se han planteado desde el inicio.

El objetivo es dar lugar a un formato que combine la reunión de expertos en el ámbito legal y fiscal con una pincelada de feria tecnológica. Para tener también un espacio de exposición de soluciones digitales.

El evento se abrió con uno de los ponentes estrella. Dan Hunter tiene una larga trayectoria como especialista en la simbiosis que la informática y el derecho han cultivado en las últimas décadas. Además, este reconocido experto en legal tech ha estudiado la llegada de la avalancha de la inteligencia artificial a la práctica legal. Y precisamente de sus consecuencias ha hablado durante su charla.

El ponente hizo un repaso breve a la historia de la IA. En esta narración tuvo que resaltar una fecha: “Desde 2012 el mundo de la inteligencia artificial cambió”. Este punto de inflexión se marca por el nacimiento del deep learning. Tenemos aquí una arquitectura de modelos ya muy profunda en capas. A partir de ese momento se incrementa la computación, la velocidad o el tamaño de las bases de datos. Hunter explica cómo todo se ha acelerado.

Ahí es donde la verdadera carrera empezó. Pero Hunter destaca otro año, el de 2017, cuando un equipo de Google creó el transformador. Este concepto dará lugar a los grandes modelos de IA, como ChatGPT, Gemini o Claude. Por supuesto, desembocará en diciembre de 2022 en el lanzamiento en abierto de ChatGPT. Sin el descubrimiento previo no habría sido posible.

El decano ejecutivo de la The Dickson Poon School of Law se sitúa ya en el momento actual y lanza al auditorio una constatación: “Estamos en este punto en el que el mundo ha cambiado y no habrá LLMs (modelos de lenguaje de gran tamaño) que sean peor que los de ahora”. Esto quiere decir que solo estamos ante un punto de partida.

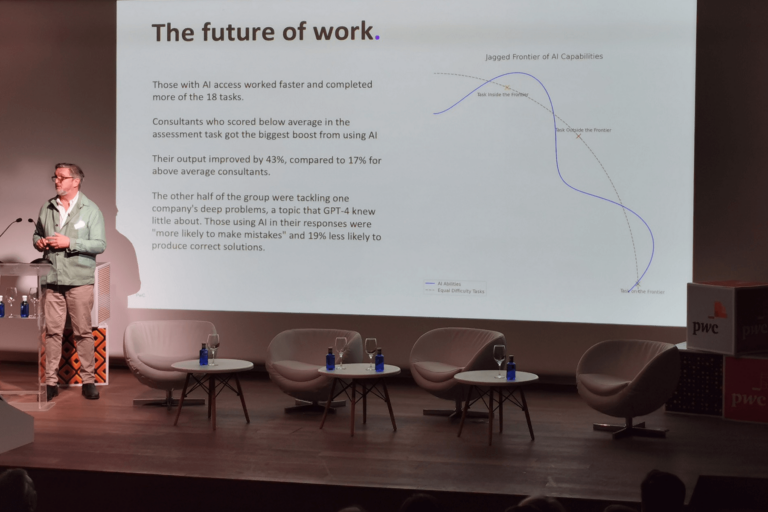

“Ahora tenemos una situación en la que los trabajadores más capacitados mejoran un poco con la IA, mientras que los menos capacitados mejoran mucho con IA”, ha apuntado Hunter y ha llevado su conferencia al terreno del derecho. “Los abogados usan muchas palabras y los LLMs son buenos creando palabras en contextos en las que tienen valor”, ha incidido.

El catedrático ha mostrado datos que demostraban cómo los estudiantes de derecho respondieron mejor a ciertas preguntas sobre su materia con asistencia de la IA. También a la hora de llevar a cabo tareas puramente profesionales, como crear un borrador de contratos. Lo hicieron de forma más rápida y con mayor calidad.

Mayor productividad

Cuando se utiliza la inteligencia artificial con una intención definida, la productividad aumenta, según Hunter. “Lo más importante es que la gente están más contenta porque les gusta usar estos modelos”, argumenta, y añade que en algunas empresas no dejan utilizar estas herramientas. ¿Cuál es la solución de los empleados? La usan sin decirlo. Esto presenta un riesgo, que proviene de no adoptar los modelos de IA. “La gente los usará de todas formas”, asegura Hunter. Pero lo hará sin control ni una metodología definida.

Hay otros riesgos, como el de la famosa caja negra. “A los LLMs no puedes preguntarle por qué está diciendo lo que está diciendo. Solo está creando una palabra cada vez. Puedes crear un conjunto muy viable de palabras pero no sabes de dónde viene. Esto tenemos que asumirlo y siempre poner una persona en el circuito (el llamado human-in-the-loop), un abogado en este caso. Y nunca dejar a la IA funcionar por sí sola”, ha comentado el catedrático.

El sesgo es otro de los riesgos que hay que abordar. Hunter ponía el ejemplo del algoritmo que hace tiempo lanzó Amazon, que casi mayoritariamente se había entrenado con personas blancas. ¿El problema? Afirmaba que Oprah Winfrey era un hombre porque no reconocía adecuadamente a personas negras. Aunque ya existen técnicas de mitigación, como robustecer el entrenamiento.

Hunter ha terminado con las alucinaciones. Uno de los grandes problemas de estos modelos de IA, que ha dado que hablar en el sector de la abogacía, especialmente con el caso de Avianca. Pero las compañías desarrolladoras de los modelos han reducido esta problemática conectando a Internet las herramientas. Es el caso de GPT-4.

La conclusión del decano ejecutivo de la The Dickson Poon School of Law es clara: “Si no adoptas la inteligencia artificial, la gente lo va a hacer y crearás un problema de seguridad. Y el tiempo de hacerlo es ahora. Porque si la tecnología se mueve tan rápido como todo indica, necesita hacerlo ya”.