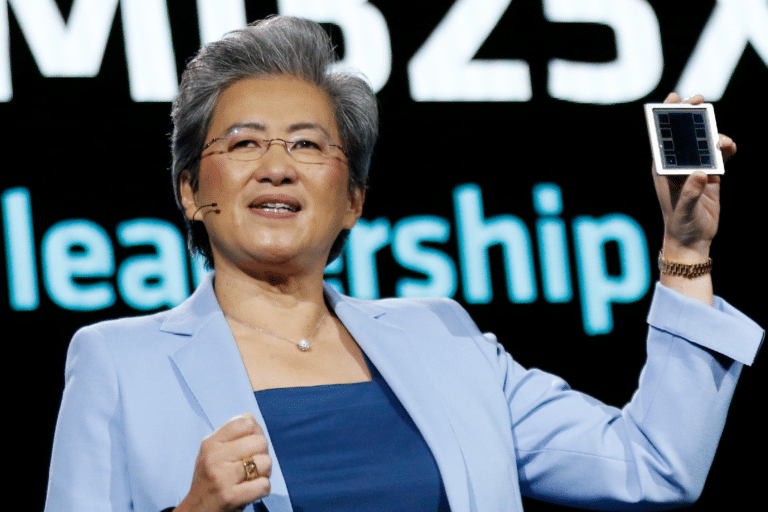

AMD ha presentado su último chip, el Instinct MI325X, un acelerador de inteligencia artificial específicamente diseñado para competir directamente con NVIDIA en el mercado de centros de datos orientados a IA. Este nuevo componente, basado en la arquitectura CDNA 3, se posiciona como una alternativa de alto rendimiento frente a los productos más avanzados de su competidor. Según AMD, el MI325X supera hasta en un 30% al modelo H200 de NVIDIA en tareas intensivas de inteligencia artificial.

El Instinct MI325X está concebido para proporcionar un rendimiento y una eficiencia excepcionales en aplicaciones de inteligencia artificial, incluyendo el entrenamiento de modelos, la optimización y la inferencia. La GPU dispone de 304 unidades de cómputo (CUs) y soporta hasta 256 GB de memoria HBM3E con un ancho de banda de 6,0 TB/s, posicionándose como una herramienta formidable para la aceleración de modelos de IA en centros de datos a gran escala.

En cuanto al rendimiento teórico, el MI325X alcanza una precisión máxima de 1307,4 TFLOPS en FP16 y BF16, y 2614,9 TFLOPS en FP8, mientras que en enteros (INT8) se sitúa en 1.978,9 TOPS. Además, pruebas realizadas en modelos de referencia como Mistral 7B, Llama 3.1 70B y Mixtral 8x7B indican que el MI325X supera significativamente el rendimiento del H200 de NVIDIA, lo cual refuerza las afirmaciones de AMD sobre la superioridad de su chip en tareas de inferencia.

Disponibilidad

Durante la presentación del nuevo chip, AMD también confirmó que la producción del MI325X comenzará antes de finalizar el año 2024. En paralelo, la compañía ha asegurado acuerdos de colaboración con fabricantes líderes como Dell, Gigabyte, HP Enterprise, Lenovo, SuperMicro y Eviden, con el objetivo de integrar el acelerador en sus sistemas para centros de datos. Se espera que el MI325X esté disponible comercialmente durante el primer trimestre de 2025.

El lanzamiento del Instinct MI325X vino acompañado de una hoja de ruta clara para los próximos lanzamientos de AMD. La compañía tiene previsto introducir la serie MI350, basada en la arquitectura CDNA 4, durante la segunda mitad de 2025, y posteriormente la serie MI400, que utilizará una arquitectura de próxima generación en 2026. AMD aseguró que la línea de aceleradores para inteligencia artificial se ha convertido en la categoría de productos con el mayor crecimiento en la historia de la empresa.

El MI350 se perfila como una evolución significativa respecto al MI325X, ofreciendo una mejora de 35 veces en el rendimiento de inferencia y una capacidad de hasta 288 GB de memoria HBM3E por acelerador. Estas mejoras tienen como finalidad consolidar la presencia de AMD en el competitivo mercado de la inteligencia artificial.

Perspectivas

AMD también está apostando por fortalecer el soporte de sus aceleradores para las principales bibliotecas y modelos de IA, tales como el Llama 3.2 de Meta y Stable Diffusion 3. Además, los aceleradores Instinct ya son compatibles con más de un millón de modelos de lenguaje en la plataforma Hugging Face, lo cual subraya el esfuerzo de AMD por ofrecer un entorno robusto y eficiente para los desarrolladores.

La estrategia de AMD no solo busca competir con NVIDIA en términos de rendimiento, sino también ofrecer una ventaja en el coste total de propiedad, proporcionando una relación coste-rendimiento favorable. Esto puede traducirse en un rendimiento superior al mismo precio que la competencia, o una capacidad equivalente a un coste menor. No obstante, AMD aún no ha revelado el precio del MI325X, aunque se espera que sea inferior a los 28.900 dólares (unos 26.428 euros) que cuesta el H200 de NVIDIA, lo cual refuerza su enfoque en la competitividad.