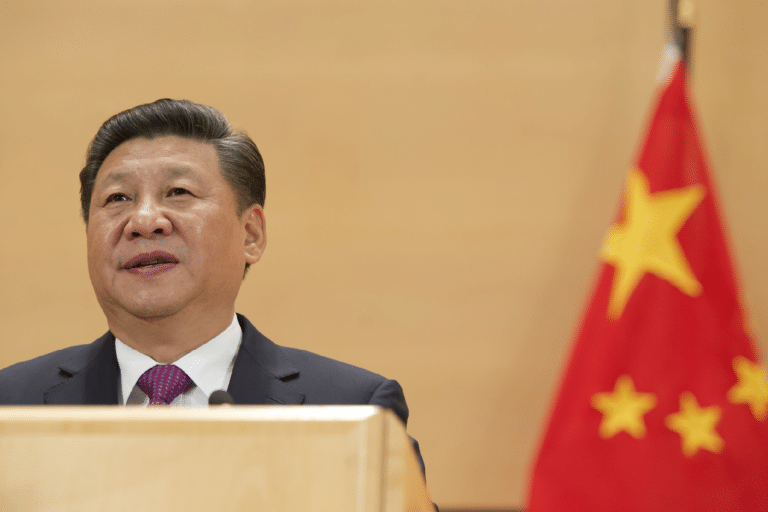

A China continua com seu "esforço de censura" e, nesse caso, é a Inteligência Artificial Generativa que está sofrendo. A ideia do governo de Xi Jinping é que a IA futura seja baseada nos princípios socialistas do país. Vinte anos após a introdução de um "grande firewall" para bloquear sites estrangeiros e outras informações consideradas prejudiciais pelo Partido Comunista (CPC), agora é a vez do governo controlar essa nova tecnologia que está varrendo o planeta.

Para realizar esse controle, de acordo com o Financial Time, funcionários do governo chinês estão testando modelos de linguagem de grandes empresas de inteligência artificial para garantir que seus sistemas "incorporem os valores socialistas fundamentais". Empresas como ByteDance, Alibaba, Moonshot e 01.AI estão sendo auditadas pelo "grande" supervisor da China: a Administração do Ciberespaço da China (CCA).

O processo realizado pela ACC consiste em testar as respostas dadas pelos LLMs das empresas a perguntas sobre a política chinesa e o presidente Xi Jinping. Após analisar as respostas, a equipe de "censores" da ACC revisa os dados com os quais essas IAs estão sendo treinadas para verificar se elas atendem aos parâmetros socialistas.

A FT conseguiu falar com um funcionário de uma empresa de IA e ele disse que a ACC "uma equipe especial veio ao nosso escritório e sentou-se em nossa sala de conferências para fazer a auditoria". Ele também disse que "não fomos aprovados na primeira vez; o motivo não estava muito claro, então tivemos que conversar com nossos colegas", observando que esse processo pelo qual os 'censores' passam exige "um pouco de adivinhação e adaptação". Fomos aprovados na segunda vez, mas o processo todo levou meses".

Caso a IA não atenda aos parâmetros, a filtragem começa com a remoção de informações problemáticas dos dados de treinamento e a criação de um banco de dados de palavras-chave sensíveis. A orientação operacional da China para empresas de IA emitida em fevereiro diz que os grupos de IA devem coletar milhares de palavras-chave sensíveis e perguntas que violam "valores socialistas fundamentais", como "incitar a subversão do poder do Estado" ou "minar a unidade nacional". As palavras-chave sensíveis devem ser atualizadas semanalmente.

O resultado é visível para os usuários porque consultas como o que aconteceu em 4 de junho de 1989 (a data do massacre na Praça Tiananmen) ou se Xi se parece com o Ursinho Pooh, um meme da Internet, são rejeitadas pela maioria dos chatbots chineses.

Em vez disso, Pequim lançou um chatbot de inteligência artificial baseado em um novo modelo da filosofia política do presidente chinês, conhecido como "Pensamento de Xi Jinping sobre o Socialismo com Características Chinesas para uma Nova Era", bem como em outra literatura oficial fornecida pela Administração do Ciberespaço da China.

Para evitar a flagrante censura chinesa, as autoridades limitaram o número de respostas que os chatbots podem evitar quando perguntados sobre qualquer assunto político, e o padrão também introduzido em fevereiro afirma que eles não devem rejeitar mais de cinco por cento das perguntas.

"Durante o teste, eles têm que responder, mas quando começam, ninguém os observa", disse um desenvolvedor de uma empresa de Internet com sede em Xangai. "Para evitar possíveis problemas, alguns dos principais modelos implementaram uma proibição geral de tópicos relacionados ao presidente.".

Especialistas chineses afirmam que a ByteDance, proprietária do TikTok, foi a que mais avançou na criação de um LLM que repete habilmente os argumentos de Pequim. Um laboratório de pesquisa da Universidade de Fudan, que fez ao chatbot perguntas difíceis sobre os principais valores socialistas, deu a ele a melhor classificação entre os LLMs com uma "taxa de conformidade de segurança" de 66,4%, bem à frente dos 7,1% do GPT-4o da OpenAI no mesmo teste.